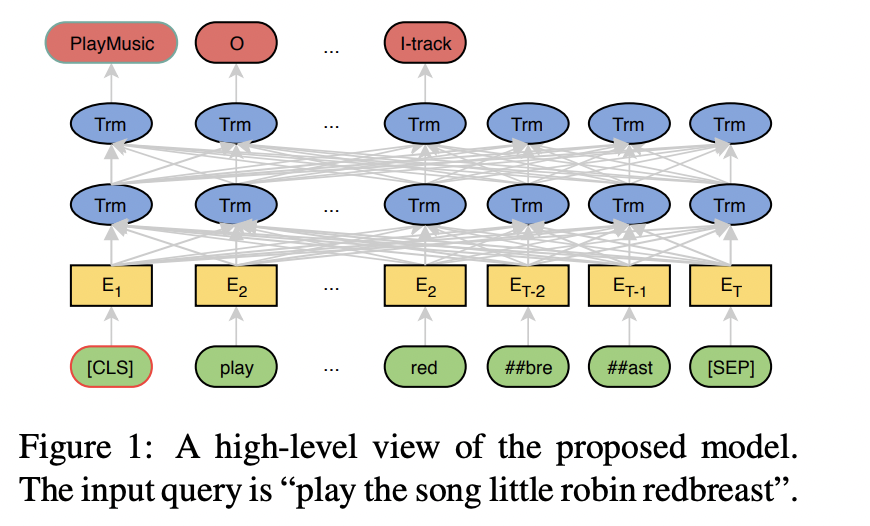

這篇論文很單純,就是用Bert同時做兩種任務 Intent Classification 和 Slot filling, Intent Classification 和 slot filling 常常數據集都很小,也常常會有一些不常見的字或者專有名詞,導致模型學得不好缺乏泛化能力

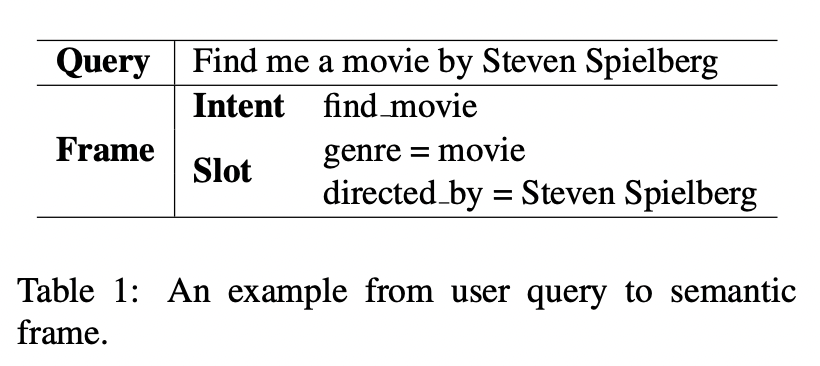

NLU一般來說包含intent classification 和 slot filling,目標就是要判別出講話的人他想要表達什麼

slot filling就是給定句子 x1, x2, .., x_T,slot label y1, y2, …., y_T,要預測 y1, y2, …, y_T

BIO 標註方法